一、前言

在多线程并发编程中volatile和synchronized都扮演着重要的角色,volatile是轻量级的

snychronized,它在多处理器开发中保证了共享变量的“可见性”。

可见性的意思是当一个线程修改了一个共享变量时,其他线程能读到这个修改的值。volatile使用恰当的话,比synchronized的使用和执行成本更低,因为它不会引起线程上下文的切换和调度。

二、volatile的定义与实现原理

Java语言规范第3版中对volatile的定义如下:Java编程语言允许线程访问共享变量,为了确保共享变量能被准确和一致地更新,线程应该确保通过排他锁单独获得这个变量。Java语言提供了volatile,在某些情况下比锁要更加方便。如果一个字段被声明成volatile,Java线程内存模型确保所有线程看到这个变量的值是一致的。

volatile相关的CPU术语:

| 术语 | 英文 | 描述 |

|---|---|---|

| 内存屏障 | memory barries | 一组处理器指令,实现对内存操作的顺序限制 |

| 缓冲行 | cache line | 缓存中可以分配的最小存储单位。处理器填写缓存时会加载整个缓存线,需要使用多个主内存度周期 |

| 原子操作 | atomic operations | 不可中断的一个或一系列操作 |

| 缓存行填充 | cache line fill | 当处理器识别到内存中读取操作数是可缓存的,处理器读取整个缓存行到适当的位置(L1,L2,L3的或所有) |

| 缓存命中 | cache hit | 如果进行高速缓存行填充操作的内存位置仍然是下一次处理器访问的地址时,处理器从缓存中读取操作数,而不是从内存中读 |

| 写命中 | write hit | 当处理器将操作数写回一个内存缓存区域时,首先会先检查这个缓存的内存地址是否在缓存行中,如果存在一个有效的缓存行,则处理器将这个操作数写回缓存,而不是写回内存,这个操作被称为写命中 |

| 写缺失 | write miss the cache | 一个有效的缓存行被写入到了不存在的内存区域 |

那么volatile是如何保证可见性的?

Java代码:

|

|

编译之后的汇编:

|

|

用volatile修饰变量之后,有volatile变量修饰的共享变量进行写操作的时候会多出lock指令,转成汇编发现使用到了lock前缀指令。Lock前缀的指令在多核处理器下会引发了两件事情:

1、将当前处理器缓存行的数据写回到系统内存

2、这个写回内存的操作会使在其他CPU里缓存了改内存地址的数据失效

速度对比:光盘<U盘<硬盘<内存<高速缓存<CPU。由于CPU的速度比内存的快,所以为了提高处理速度,处理器不直接和内存进行通信,而是先将系统内存的数据读到内部缓存(L1,L2或其他)后再进行操作,但操作完不知道何时会写到内存。

如果对声明了volatile的变量进行写操作,JVM就会向处理器发送一条Lock前缀的指令,将这个变量所在缓存行的数据写回到系统内存。 所以,在多处理器下,为了保证各个处理器的缓存是一致的,就会实现缓存一致性协议,每个处理器通过嗅探在总线上传播的数据来检查自己缓存的值是不是过期了,当处理器发现自己缓存行对应的内存地址被修改,就会将当前处理器的缓存行设置成无效状态,当处理器对这个数据进行修改操作的时候,会重新从系统内存中把数据读到处理器缓存里。

1.1 volatile的使用优化

Doug lea大神在开发JUC里面的一个队列集合类LinkedTransferQueue,使用了volatile关键字,用一种追加字节的方式来优化队列出队和入队的性能。

|

|

因为一些处理器的高速缓存行是64字节宽,不支持部分填充缓存行。如果队列的头节点和尾节点都不足64字节的话,处理器会将它们都读到同一个高速缓存行中,在多处理器下每个处理器都会缓存同样的头、尾节点,当一个处理器试图修改头节点时,会将整个缓存行锁定,那么在缓存一致性机制的作用下,会导致其他处理器不能访问自己高速缓存中的尾节点,而队列的入队和出队操作则需要不停修改头节点和尾节点,所以在多处理器的情况下将会严重影响到队列的入队和出队效率。使用追加到64字节的方式来填满高速缓冲区的缓存行,避免头节点和尾节点加载到同一个缓存行,使头、尾节点在修改时不会互相锁定。

适用情况:

- 缓存行非64字节宽的处理器

- 共享变量不会被频繁修改

三、synchronized的实现原理与应用

很多人都会称呼synchronized为重量级锁。但是,随着Java SE 1.6对synchronized进行了各种优化之后,有些情况下它就并不那么重了。为了减少获得锁和释放锁带来的性能消耗而引入的偏向锁和轻量级锁,以及锁的存储结构和升级过程。

synchronized的锁:

- 对于普通同步方法,锁是当前实例对象。

- 对于静态同步方法,锁是当前类的Class对象。

- 对于同步方法块,锁是Synchonized括号里配置的对象。

当一个线程试图访问同步代码块时,它首先必须得到锁,退出或抛出异常时必须释放锁。

JVM基于进入和退出Monitor对象来实现方法同步和代码块同步,但两者的实现细节不一样。代码块同步是使用monitorenter和monitorexit指令实现的,而方法同步是使用另外一种方式实现的,细节在JVM规范里并没有详细说明。但是,方法的同步同样可以使用这两个指令来实现。

monitorenter指令是在编译后插入到同步代码块的开始位置,而monitorexit是插入到方法结束处和异常处,JVM要保证每个monitorenter必须有对应的monitorexit与之配对。任何对象都有一个monitor与之关联,当且一个monitor被持有后,它将处于锁定状态。线程执行到monitorenter指令时,将会尝试获取对象所对应的monitor的所有权,即尝试获得对象的锁。

2.1 Java对象头

synchronized用的锁是存在Java对象头里的。如果对象是数组类型,则虚拟机用3个字宽(Word)存储对象头,如果对象是非数组类型,则用2字宽存储对象头。在32位虚拟机中,1字宽等于4字节,即32bit

| 长度 | 内容 | 说明 |

|---|---|---|

| 32/64bit | Mark Word | 存储对象的hashCode或锁信息等 |

| 32/64bit | Class Metadata Address | 存储到对象类型数据的指针 |

| 32/64bit | Array length | 数组的长度(如果对象是数组) |

Java对象头里的Mark Word里默认存储对象的HashCode、分代年龄和锁标记位。32位JVM的Mark Word的默认存储结构

| 锁状态 | 25bit | 4bit | 1bit是否是偏向锁 | 2bit锁标记位 |

|---|---|---|---|---|

| 无锁状态 | 对象的hashCode | 对象分代年龄 | 0 | 01 |

运行期间可能发生的变化

| 锁状态 | 25bit | 4bit | 1bit | 2bit | ||

| 23bit | 2bit | 是否偏向锁 | 锁标记位 | |||

| 轻量级锁 | 指向栈中锁记录的指针 | 00 | ||||

| 重量级锁 | 指向互斥量(重量级锁)的指针 | 10 | ||||

| GC标记 | 空 | 11 | ||||

| 偏向锁 | 线程ID | Epoch | 对象分代年龄 | 1 | 01 | |

64位虚拟机,Mark Word如下

| 锁状态 | 25bit | 31bit | 1bit | 4bit | 1bit | 2bit |

| cms_free | 分代年龄 | 偏向锁 | 锁标记位 | |||

| 无锁 | unused | hashCode | 0 | 01 | ||

| 偏向锁 | ThreadId(54bit) Epoch(2bit) | 0 | 01 | |||

2.2 锁升级与对比

Java SE 1.6为了减少获得锁和释放锁带来的性能消耗,引入了“偏向锁”和“轻量级锁”。锁一共有4种状态,级别从低到高依次是:无锁状态、偏向锁状态、轻量级锁状态和重量级锁状态,这几个状态会随着竞争情况逐渐升级。锁可以升级但不能降级,意味着偏向锁升级成轻量级锁后不能降级成偏向锁。这种锁升级却不能降级的策略,目的是为了提高获得锁和释放锁的效率。

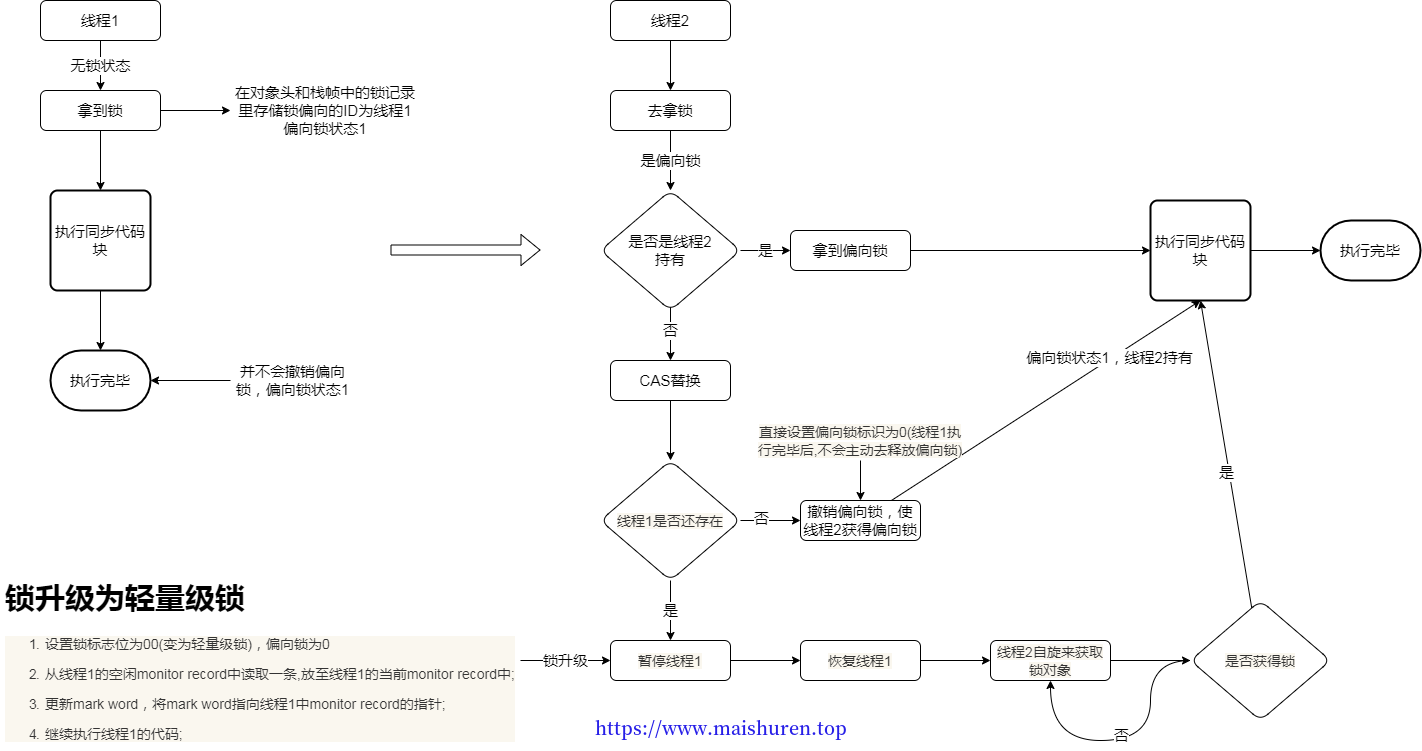

2.2.1 偏向锁

大多数情况下,锁不仅不存在多线程竞争,而且总是由同一线程多次获得,为了让线程获得锁的代价更低而引入了偏向锁。当一个线程访问同步块并获取锁时,会在对象头和栈帧中的锁记录里存储锁偏向的线程ID,以后该线程在进入和退出同步块时不需要进行CAS操作来加锁和解锁,只需简单地测试一下对象头的Mark Word里是否存储着指向当前线程的偏向锁。如果测试成功,表示线程已经获得了锁。如果测试失败,则需要再测试一下Mark Word中偏向锁的标识是否设置成1(表示当前是偏向锁):如果没有设置,则使用CAS竞争锁;如果设置了,则尝试使用CAS将对象头的偏向锁指向当前线程。

偏向锁的撤销:

偏向锁使用了一种等到竞争出现才释放锁的机制,所以当其他线程尝试竞争偏向锁时,持有偏向锁的线程才会释放锁。

偏向锁的撤销,需要等待全局安全点(在这个时间点上没有正在执行的字节码)。它会首先暂停拥有偏向锁的线程,然后检查持有偏向锁的线程是否活着,如果线程不处于活动状态,则将对象头设置成无锁状态;如果线程仍然活着,拥有偏向锁的栈会被执行,遍历偏向对象的锁记录,栈中的锁记录和对象头的Mark Word要么重新偏向于其他线程,要么恢复到无锁或者标记对象不适合作为偏向锁,最后唤醒暂停的线程。

关闭偏向锁:

偏性锁是在应用程序启动后几秒钟才激活的,可以通过JVM参数来关闭延迟:-XX:BiasedLockingStartupDelay=0。

也可以通过JVM参数关闭偏向锁:-XX:-UseBiasedLocking=false,那么程序默认会进入轻量级锁状态。

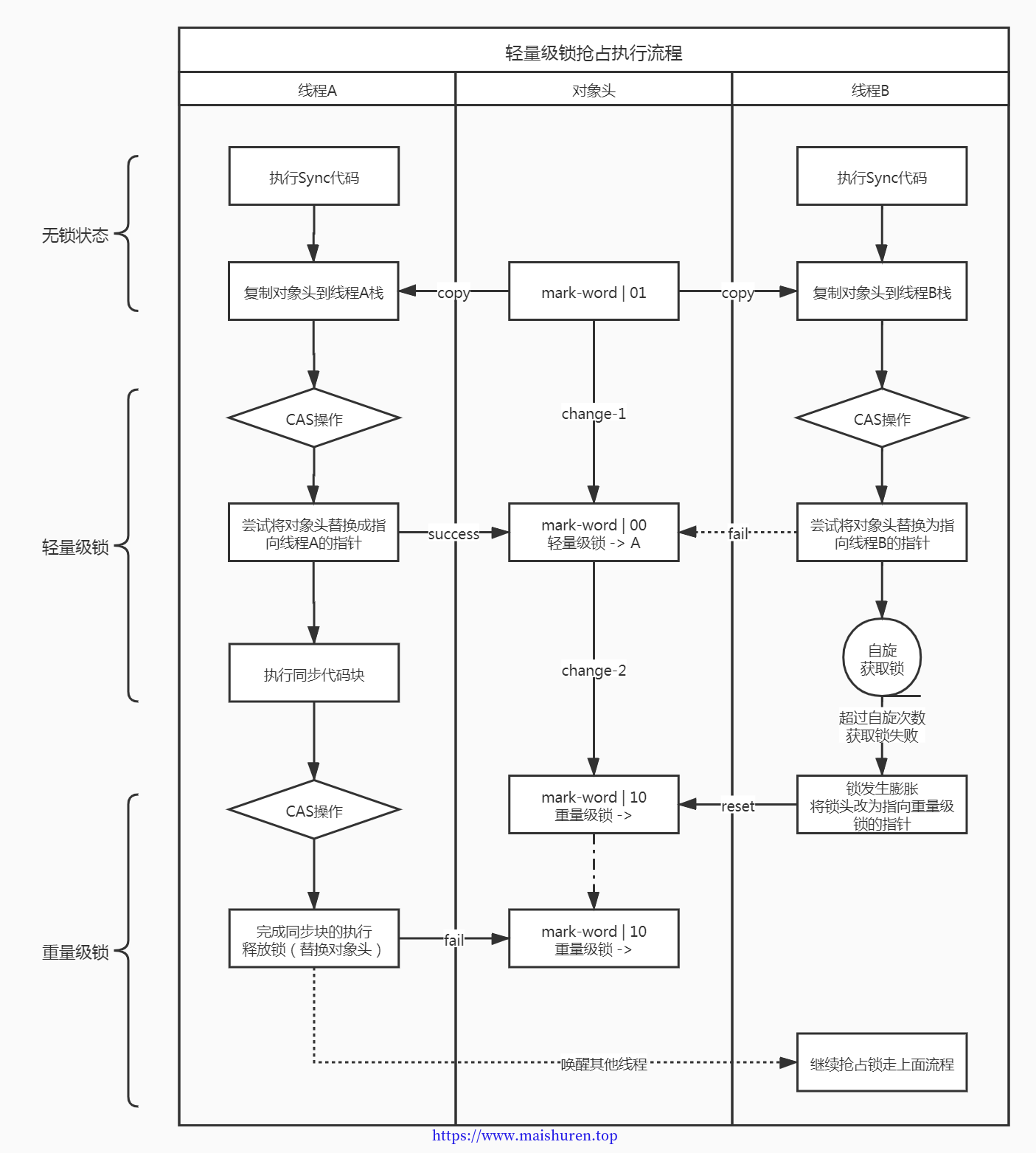

2.2.2 轻量级锁

轻量级锁加锁:

线程在执行同步块之前,JVM会先在当前线程的栈桢中创建用于存储锁记录的空间,并将对象头中的Mark Word复制到锁记录中,官方称为Displaced Mark Word。然后线程尝试使用CAS将对象头中的Mark Word替换为指向锁记录的指针。如果成功,当前线程获得锁,如果失败,表示其他线程竞争锁,当前线程便尝试使用自旋来获取锁。

轻量级解锁:

轻量级解锁时,会使用原子的CAS操作将Displaced Mark Word替换回到对象头,如果成功,则表示没有竞争发生。如果失败,表示当前锁存在竞争,锁就会膨胀成重量级锁

偏向锁升级成轻量级锁:

轻量级锁膨胀成重量级锁:

自旋会消耗CPU,为了避免无用的自旋(比如获得锁的线程被阻塞住了),一旦锁升级成重量级锁,就不会再恢复到轻量级锁状态。当锁处于这个状态下,其他线程试图获取锁时,都会被阻塞住,当持有锁的线程释放锁之后会唤醒这些线程,被唤醒的线程就会进行新一轮的夺锁之争。

2.2.3 锁的对比

| 锁 | 优点 | 缺点 | 使用场景 |

|---|---|---|---|

| 偏向锁 | 加锁和解锁不需要额外的消耗,和执行非同步方法对比仅存在纳秒级的差距 | 如果线程间存在锁竞争,会带来额外的锁撤销的消耗 | 适用于只有一个线程访问同步代码块场景 |

| 轻量级锁 | 竞争的线程不会阻塞,提高了程序的响应速度 | 如果始终得不到锁竞争的线程,使用自旋会消耗CPU | 追求响应时间,同步代码块执行速度非常快 |

| 重量级锁 | 线程竞争不使用自旋,不会消耗CPU | 线程阻塞,影响时间缓慢 | 追求吞吐量,同步代码块执行速度较长 |

五、原子操作

原子操作(atomic operation)意为“不可被中断的一个或一系列操作”。

使用总线锁保证原子性:

第一个机制是通过总线锁保证原子性。如果多个处理器同时对共享变量进行读改写操作(i++就是经典的读改写操作),那么共享变量就会被多个处理器同时进行操作,这样读改写操作就不是原子的,操作完之后共享变量的值会和期望的不一致。

例如:执行两次i++操作,期望的执行结果是3,但是在多处理器下执行结果可能不是3.

CPU1: i=1;i+1;i=2;

CPU1: i=1;i+1;i=2;

结果:i=2

因为多处理器会读取自己的缓存中的变量i,分别进行+1操作,然后分别写入主内存。所以想要保证读改写共享变量的操作是原子的,就必须保证CPU1读改写共享变量的时候,CPU2不能操作缓存了该共享变量内存地址的缓存。

处理器使用总线锁就是来解决这个问题的。所谓总线锁就是使用处理器提供的一个 LOCK#信号,当一个处理器在总线上输出此信号时,其他处理器的请求将被阻塞住,那么该处理器可以独占共享内存。

使用缓存锁保证与原子性:

在同一时刻,我们只需保证对某个内存地址的操作是原子性即可,但总线锁定把CPU和内存之间的通信锁住了,这使得锁定期间,其他处理器不能操作其他内存地址的数据,所以总线锁定的开销比较大,

所谓“缓存锁定”是指内存区域如果被缓存在处理器的缓存行中,并且在Lock操作期间被锁定,那么当它执行锁操作回写到内存时,处理器不在总线上声言LOCK#信号,而是修改内部的内存地址,并允许它的缓存一致性机制来保证操作的原子性,因为缓存一致性机制会阻止同时修改由两个以上处理器缓存的内存区域数据,当其他处理器回写已被锁定的缓存行的数据时,会使缓存行无效。

不使用缓存锁定的情况:

- 当操作的数据不能被缓存在处理器内部,或操作的数据跨多个缓存行(cache line)时,则处理器会调用总线锁定。

- 有些处理器不支持缓存锁定。对于Intel 486和Pentium处理器,就算锁定的 内存区域在处理器的缓存行中也会调用总线锁定。

5.1 使用CAS实现原子操作的三大问题

在Java并发包中使用了自旋CAS的方式来实现原子操作。但是会引发三大问题:1)ABA问题。2)如果长时间自旋,CPU开销大。3)只能保证一个共享变量的原子操作

ABA问题:

i=1;

线程1:i=2; i=1; i=>1->2->1

线程2通过CAS获得到的i确实是等于1,但是i已经被被修改过。

JDK的Atomic包里提供了一个类AtomicStampedReference来解决ABA问题。在每次修改变量时版本号都会+1,在ABA问题时,虽然期望值符合,但是版本号却是不符合的。

循环时间长开销大:

因为是线程在CAS的时候一直不成功,它会一直在哪里空转,如果大量的线程都一直在自旋,那么会给CPU带来非常大的开销。

只能保证一个共享变量的原子操作:

当对一个共享变量执行操作时,我们可以使用循环CAS的方式来保证原子操作,但是对多个共享变量操作时,循环CAS就无法保证操作的原子性,这个时候就可以用锁。还有一个取巧的办法,就是把多个共享变量合并成一个共享变量来操作。比如,有两个共享变量i=2,j=a,合并一下ij=2a,然后用CAS来操作ij。从Java 1.5开始,JDK提供了AtomicReference类来保证引用对象之间的原子性,就可以把多个变量放在一个对象里来进行CAS操作。